- تسجيل الدخول

- Support

-

هل لديك سؤال؟ فريقنا هنا للمساعدة على توجيهك في رحلتك في مجال التشغيل الآلي.

-

استكشف خطط الدعم المصممة خصيصًا لتلبية متطلبات الأعمال لديك.

-

كيف يمكننا مساعدتك؟

-

- البحث

- المنتجات

أتمتة أي عملية، من أي مكان بسِّط مهام سير العمل المعقدة والحيوية ذات الأهمية الكبيرة باستخدام نظام أتمتة عمليات الوكيل. استكشاف المنصة استكشاف المنصة

- نظام الذكاء الاصطناعي

- إنشاء برامج وكلاء الذكاء الاصطناعي

قم بأتمتة المهام المتقدمة باستخدام AI Agent Studio.

- تبسيط مسارات العمل

صمم وانشر بسرعة باستخدام Automator AI.

- معالجة المستندات المعقدة

استخرج البيانات ونظِّمها باستخدام Document Automation.

- اكتشاف الفرص

اكتشف أوجه القصور باستخدام Process Discovery.

- تنسيق الأتمتة

قم بمركزة المبادرات باستخدام Automation Workspace.

- إنشاء برامج وكلاء الذكاء الاصطناعي

- نظام التشغيل الآلي

- إدارة البرامج

أسِّس أطر العمل والإشراف باستخدام CoE Manager.

- الأتمتة من أي تطبيق

احصل على مساعدة مدعومة بالذكاء الاصطناعي من خلال Automation Co-Pilot.

- توحيد الأنظمة

اربط التطبيقات ومهام سير العمل بتكاملات سلسة.

- إدارة البرامج

- عرض كل المنتجات

-

- الحلول

الحلول المميّزة

Google Cloud يدعم كل من Google Cloud وAutomation Anywhere المؤسسات لتسريع وتيرة رحلة الذكاء الاصطناعي والتشغيل الآلي. Google Cloud

Google Cloud يدعم كل من Google Cloud وAutomation Anywhere المؤسسات لتسريع وتيرة رحلة الذكاء الاصطناعي والتشغيل الآلي. Google Cloud Amazon Web Services بسّط مهام سير العمل وقلل التكاليف وسهّل الأتمتة بصورة إضافية من خلال الجمع بين نظام أتمتة عمليات الوكيل وAWS Amazon Web Services

Amazon Web Services بسّط مهام سير العمل وقلل التكاليف وسهّل الأتمتة بصورة إضافية من خلال الجمع بين نظام أتمتة عمليات الوكيل وAWS Amazon Web Services - الموارد

الحصول على Community Edition: ابدأ التشغيل الآلي على الفور بفضل الوصول المجاني إلى التشغيل الآلي الكامل الميزات من خلال Community Edition على السحابة.

مميز

تصنيف الريادة في تقرير Gartner® Magic Quadrant™ للعام 2024 في مجال التشغيل الآلي. الاحتفال بمرور ست سنوات على الاعتراف بها وتقديرها كرائدة في مجالها.تنزيل التقرير تنزيل التقرير

تصنيف الريادة في تقرير Gartner® Magic Quadrant™ للعام 2024 في مجال التشغيل الآلي. الاحتفال بمرور ست سنوات على الاعتراف بها وتقديرها كرائدة في مجالها.تنزيل التقرير تنزيل التقرير- الموارد

- المعلومات

- استكشاف

- الشركاء

- عرض كل الموارد

-

- العملاء

تسجيل دخول العميل

عملية تسجيل الدخول هذه عبارة عن تسجيل دخول أحادي للعملاء الحاليين مع Automation Anywhere. تسجيل الدخول الآن تسجيل الدخول الآن

شهادات جديدة ومحسّنة

امنح نفسك ميزة تنافسية مع الشهادات المعترف بها في القطاع من Automation Anywhere.استعرض الشهادات استعرض الشهادات

امنح نفسك ميزة تنافسية مع الشهادات المعترف بها في القطاع من Automation Anywhere.استعرض الشهادات استعرض الشهادات - الشركة

تواصل معنا احصل على المساعدة أو اعرف المزيد أو تعلّم أو اطرح الأسئلة أو دردش معنا فقط! اتصل بنا اتصل بنا

- تعرّف علينا

- الإعلانات

- المجتمع

-

- الصفحة الرئيسية

- المدوّنة

- الذكاء الاصطناعي المسؤول: الابتكار والحوكمة معًا لدفع النجاح

المدونة

الذكاء الاصطناعي المسؤول: الابتكار والحوكمة معًا لدفع النجاح

نحن نقف عند نقطة محورية في الثورة التكنولوجية. من موضعنا اليوم، سيستمر استخدام الذكاء الاصطناعي في النمو، متغلغلاً في كل صناعة. إنها فرصة هائلة - يمكن للذكاء الاصطناعي والأتمتة المدعومة بالذكاء الاصطناعي تحسين إنتاجية الإنسان وكفاءته وتحقيق الإيرادات - لكنها تأتي أيضًا مع حاجة كبيرة إلى الأمان والحوكمة.

تحقيق التوازن بين الابتكار والممارسات المسؤولة

كيف يمكن للمنظمات التي تستثمر في الذكاء الاصطناعي أن تحقق التوازن بين الابتكار والممارسات المسؤولة؟ من الضروري تطوير أطر العمل في أقرب وقت ممكن. بينما كانت عملية الابتكار التكنولوجي تاريخيًا تتمثل في الإطلاق، ثم التفكير في الحوكمة والإرشادات، يجب أن يتغير هذا المفهوم. بينما ننشئ التكنولوجيا الجديدة اليوم، يجب علينا إنشاء أطر العمل في نفس الوقت.

فكِّر في برامج وكلاء الذكاء الاصطناعي من Automation Anywhere، التي تم الإعلان عنها في Imagine 2024. تتعلم برامج وكلاء الذكاء الاصطناعي من بيانات المؤسسات من أجل اتخاذ قرارات مناسبة واتخاذ إجراءات عبر نظام المؤسسة. تعد الأدوات مثل هذه غير مسبوقة، ولكن تم إنشاؤها منذ البداية مع تدعيمها بحواجز حماية وعقلية ذكاء اصطناعي واعية بالحوكمة. في الواقع، تكون برامج وكلاء الذكاء الاصطناعي هذه جاهزة لتكون فعالة لأنها مصممة ضمن إطار حوكمة ذكاء اصطناعي قوي يركز على المسؤولية، بما في ذلك الاهتمام بالأمن والموثوقية والمساءلة، من بين ميزات أخرى.

أطر عمل الصناعة لنشر الذكاء الاصطناعي بشكل آمن

في ظل تطور هذه الصناعة، تساعد أطر العمل مثل إطار عمل إدارة مخاطر الذكاء الاصطناعي التابع للمعهد الوطني للمعايير والتكنولوجيا (NIST) في ضمان نشر الذكاء الاصطناعي بشكل آمن وأخلاقي وفعال. يوفر قانون الذكاء الاصطناعي في الاتحاد الأوروبي أيضًا إطارًا تنظيميًا شاملاً قائمًا على المخاطر لمعالجة التحديات المتعلقة بالسلامة التي تطرحها تقنيات الذكاء الاصطناعي.

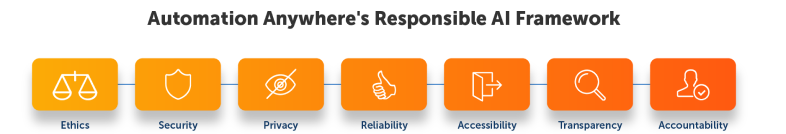

بوجه عام، فإن نهجنا نحو الذكاء الاصطناعي المسؤول عبر Automation Anywhere—مع وكلاء الذكاء الاصطناعي وما بعدها—يستند إلى هذه المبادئ السبعة التي تشكل إطار عملنا للذكاء الاصطناعي المسؤول:

الأخلاقيات: نحن نؤمن بأن الذكاء الاصطناعي يجب أن يمنع الضرر ويعزز كرامة الإنسان وحقوقه وحريته.

الأمن: نحن نولي أولوية للأمن المدمج ونوفر الحماية ضد مجموعة متنوعة من التهديدات.

الخصوصية: تمتلك الأطراف المعنية لدينا الوضوح، والتحكم، والإشراف على تخزين بياناتها، والوصول إليها، واستخدامها.

الموثوقية: نلتزم بالاتساق والدقة والانضباط وقوة نموذج الذكاء الاصطناعي.

إمكانية الوصول: نعتقد أن الذكاء الاصطناعي من المفترض أن يكون شاملاً ومتاحًا للجميع.

الشفافية: سنتحلى دائمًا بالصادق والانفتاح بشأن منتجاتنا ونماذج أعمالنا وسياساتنا.

المسؤولية: نعتقد أن الإشراف البشري ضروري في دورة حياة تطوير الذكاء الاصطناعي بأكملها.

التكيف مع مستقبل الذكاء الاصطناعي

تلتزم Automation Anywhere بشدة بهذه المبادئ، لكننا ندرك أيضًا أن الذكاء الاصطناعي يتطور بسرعة. سيستمر إطار عمل حوكمة الذكاء الاصطناعي لدينا في التكيف مع التغيرات الحتمية في التكنولوجيا والسوق واللوائح المعمول بها.

يعد إنشاء إطار عمل حوكمة مسؤول للذكاء الاصطناعي أمرًا بالغ الأهمية، ولكن من المهم بنفس القدر تكييفه للبقاء في صدارة مسؤولياتنا كمتخصصين في التكنولوجيا—وكبشر—خلال هذه الثورة.

تعرف على المزيد حول الذكاء الاصطناعي المسؤول

شاهد تحليلنا العميق حول الذكاء الاصطناعي المسؤول خلال حدث Imagine 2024 مع Kay Firth-Butterfield، الرئيسة السابقة للذكاء الاصطناعي في المنتدى الاقتصادي العالمي.

بناء مستقبل أفضل من خلال الذكاء الاصطناعي والأتمتة

نبذة عن Neeti Mehta Shukla

بصفتها الشريك المؤسس للشركة والمسؤولة عن التأثير الاجتماعي، تلتزم نيتي بتمكين المنظمات غير الربحية والارتقاء بالفئات المجتمعية المستضعفة من خلال صقل المهارات التقنية وجعل التشغيل الآلي قوة عالمية من أجل المنفعة.

الاشتراك عبر البريد الإلكتروني عرض كل المنشورات LinkedInتعرّف على نظام أتمتة عمليات الوكيل.

للطلاب والمطورين

ابدأ التشغيل الآلي على الفور بفضل الوصول المجاني إلى التشغيل الآلي الكامل الميزات من خلال Community Edition على السحابة.